别再花钱调APIKey了!2026最全免费大模型合集,国内外直连、不限额度都有

别再花钱调APIKey了!2026最全免费大模型合集,国内外直连、不限额度都有

前言

AI大模型正在以肉眼可见的速度渗透进每个开发者的日常工作流。无论你是在搭建OpenClaw智能助手、做自动化脚本,还是只是好奇想动手玩玩,一个绕不开的问题始终横在面前:API费用。

好消息是,市面上能白嫖的免费额度其实比你想象的要多得多。国内外加起来超过30个平台,每天可以免费跑几百到几千次请求,Token额度动辄千万起跳。

这篇文章帮你把这些”粮仓”系统梳理一遍。分国内、国际、第三方代理三大板块,配合场景推荐,看完就能直接上手。

作者整理于 2026年3月 | 数据以各平台官网最新公告为准

一、国内大模型API:本土优势,访问无忧

对于国内开发者来说,首要考虑的自然是不需要翻墙、延迟低、中文理解强的平台。国内几家大厂都在争相投入大模型赛道,新用户福利相当可观。

1.1 智谱AI(GLM系列)

- 接口地址:

https://open.bigmodel.cn/api/paas/v4/ - 免费额度:新用户注册即送 2000万 Token

- 代表模型:GLM-4-Flash、GLM-Z1-Flash(完全永久免费)

- 速率上限:所有模型均限30并发

- 亮点:代码生成能力在国内第一梯队,GLM-4-Flash 永久免费且无 Token 限制(仅限并发数)

💡 如果你只是想找一个长期稳定可用的免费国内接口,智谱 GLM-4-Flash 是目前最值得作为兜底方案的选择。

1.2 月之暗面 Kimi

- 接口地址:

https://platform.moonshot.cn/ - 免费额度:每分钟最多3次请求,Token 消耗不设每日上限

- 个人认证:赠送15元

- 核心特性:256K 超长上下文窗口

- 适用场景:长文本阅读、文档摘要、书籍级内容处理

Kimi 的免费策略比较独特——不限 Token,只限频率。这意味着你完全可以把它用来处理超长文档,只要不赶时间,慢慢跑就行。

1.3 硅基流动(SiliconFlow)

- 接口地址:

https://api.siliconflow.cn/v1 - 免费额度:每个模型 1000 RPM(每分钟请求次数)

- 支持模型:DeepSeek-R1-0528、Qwen3-8B、GLM-4-9B-chat 等

- 优势:并发容量大,适合高频调用场景

硅基流动更像一个”中间层聚合平台”,帮你把各家开源模型统一接口化,省去自己部署的麻烦,且限额相当慷慨。

1.4 ModelScope 魔搭社区

- 接口地址:

https://modelscope.cn/ - 免费额度:每天 2000次 免费调用(DeepSeek-R1 深度推理版限200次)

- 多模态支持:Flux.1 图像生成、QWen-Image 等

- 背后团队:阿里达摩院

如果你需要图文多模态能力,魔搭是国内目前免费开放最好的选择之一。

1.5 其他值得关注的国内平台

| 平台 | 关键信息 | 适用场景 |

|---|---|---|

| 阿里通义千问 | 支持 Qwen3、DeepSeek、Kimi 系列,新用户有测试额度 | 长文本、代码 |

| 百度文心 | 需申请预约,数理逻辑准确率 92%+ | 科学推理 |

| 腾讯混元 | 新用户测试额度,数学方向排名靠前 | 数学/逻辑 |

| 字节豆包 | 推理单价极低,支持多模态 | 高性价比首选 |

| 讯飞星火 | AI绘图、联网搜索、长文档一体化 | 综合型应用 |

| intern-ai(书生) | 10 RPM,密钥有效期6个月 | 研究/测试 |

二、国际大模型API:实力强劲,部分需翻墙

如果你的网络环境允许,国际平台的免费额度同样丰厚,而且部分平台提供的模型能力在某些维度上领先国内。

2.1 Google AI Studio(Gemini 系列)

- 接口地址:

https://generativelanguage.googleapis.com/v1beta/openai - 需要翻墙:✅

- 免费限额:

gemini-2.5-flash:30 RPM / 1440 RPD(每天1440次!)gemini-3-flash:5 RPM / 20 RPDgemini-2.5-flash-lite:10 RPM / 20 RPD

- 优势:多模态能力极强,Gemini 2.5 Flash 综合性能顶尖

单论每天可用次数,Gemini 2.5 Flash 的 1440 RPD 是目前所有免费 API 里额度最高的之一。如果你有梯子,这个必须收好。

2.2 GitHub Models

- 接口地址:

https://models.github.ai/inference - 免费额度:15 RPM / 150 RPD

- 支持模型:

gpt-4.1-mini、gpt-4.1、gpt-4o - 使用门槛:仅需 GitHub 账户,无需信用卡

能免费用上 GPT-4.1 和 GPT-4o,GitHub Models 的性价比不言而喻。对于有 GitHub 账户的开发者来说,这是最低门槛的 OpenAI 系模型入口。

2.3 Groq

- 接口地址:

https://groq.com/ - 免费额度:每天1000次请求,6000 tokens/分钟

- 核心优势:LPU 硬件加速,推理速度极快(比普通 GPU 快数倍)

- 模型:Llama 系列

如果你对响应速度有强需求——比如实时对话、流式输出——Groq 的 LPU 是目前公开可用的最快推理服务之一。

2.4 HuggingFace Serverless Inference

- 接口地址:

https://huggingface.co/ - 免费额度:每月可变积分(根据账户等级)

- 模型数量:海量开源模型(LLaMA、Mistral、Falcon 等)

- 限制:仅支持小于 10GB 的模型

HuggingFace 是开源模型的”超市”,免费额度虽然有限,但模型选择之丰富无与伦比,适合研究和横向对比不同架构。

2.5 Cloudflare Workers AI

- 接口地址:

https://developers.cloudflare.com/workers-ai/ - 免费额度:每天 10,000 Neurons(GPU 计算单位)

- 特色:全球 CDN 边缘节点加速,延迟极低

- 模型支持:LLM、嵌入、图像、音频全覆盖

Cloudflare 的优势在于全球分布——无论用户在哪里,都能就近接入最近的边缘节点,适合面向全球用户的应用。

2.6 OpenRouter

- 接口地址:

https://openrouter.ai/api/v1 - 免费额度:每天免费50次;充值10 credits后可解锁每天1000次

- 国内可直连:✅ 无需代理

- 模型支持:DeepSeek、Kimi、Qwen、Mistral 等主流模型全覆盖

OpenRouter 的价值在于”一个接口走天下”——用统一的 OpenAI 兼容格式,切换不同后端只需改模型名称,调试和对比非常方便。

2.7 更多国际平台速览

| 平台 | 免费额度 | 亮点 |

|---|---|---|

| Mistral La Plateforme | 1req/s,500K tokens/min | 欧洲最强开源模型 |

| Cerebras | 30 RPM,60K tokens/min | 超高速推理,需等待列表 |

| NVIDIA NIM | 开发者计划免费原型 | DeepSeek-v3.2 支持 |

| Scaleway Generative | 100 RPM,200K tokens/min | 免费测试中 |

| AI21 Labs | 10 积分(无需信用卡) | Jamba Large/Mini | | Together Free | Meta-Llama-3.1-8B 等 | 无明确限制 | | Fireworks AI | 免费 1 积分 |

高并发支持 |

| Cohere | 20 RPM | command-a 系列 |

三、第三方API代理:一站式访问多家模型

除了各厂的官方接口,还有一类第三方 API 聚合代理平台,通过统一接口转发,让你用一个 key 就能调用 GPT、Claude、Gemini、DeepSeek 等各家模型。

| 平台 | 免费额度 | 代表模型 | 特色 |

|---|---|---|---|

| ChatAnywhere | 每天每 IP 200次 | GPT-4o-mini、GPT-5 | 每 IP 独立计量 |

| GemAI | 赠送 ¥100 | GPT-5.1、Gemini-3 Pro、Claude Sonnet 4.5、DeepSeek-v3.2、Grok-4 | 顶级模型全覆盖 |

| API520 | 赠送 ¥100 | Claude-Opus-4.5、Gemini-3 Pro、Kimi-K2 | Claude 系列强 |

| 算力云 | 以平台实时公示为准 | QwQ-32B | P2P 共享算力 |

⚠️ 注意:第三方代理的稳定性和数据安全性不如官方直连,建议生产环境优先选官方 API,代理仅用于测试和学习。

四、按场景选API:别瞎用,找准对的那个

把这么多平台罗列出来,如果不知道该用哪个,等于没说。下面按常见场景给出具体推荐。

🎓 学习 & 测试

首选:Google AI Studio、GitHub Models、HuggingFace

理由:门槛低(GitHub 账户即用)、额度够用(1440次/天)、模型质量高,不怕折腾。

🇨🇳 国内项目开发

首选:OpenRouter、硅基流动、智谱 AI

理由:无需翻墙、延迟低、中文能力强,OpenRouter 的统一接口还方便模型切换。

⚡ 高速实时推理

首选:Groq、Cerebras

理由:LPU / WSE 专用推理芯片,响应速度远超普通 GPU,适合实时聊天、流式输出场景。

📜 超长文本处理

首选:Kimi(256K上下文)、通义千问

理由:Kimi 目前免费 API 中支持超长上下文最好的选择,处理整本书或长篇报告不在话下。

🖼️ 多模态(图文混合)

首选:ModelScope 魔搭、Google Gemini 2.5

理由:图像理解 + 文本生成两手抓,Gemini 2.5 的视觉能力尤为突出。

💻 代码生成 & 调试

首选:DeepSeek、智谱 AI、GitHub Models(GPT-4.1)

理由:DeepSeek R1 的推理 + 代码能力在国内独树一帜,智谱 GLM-4 永久免费也是稳定选项。

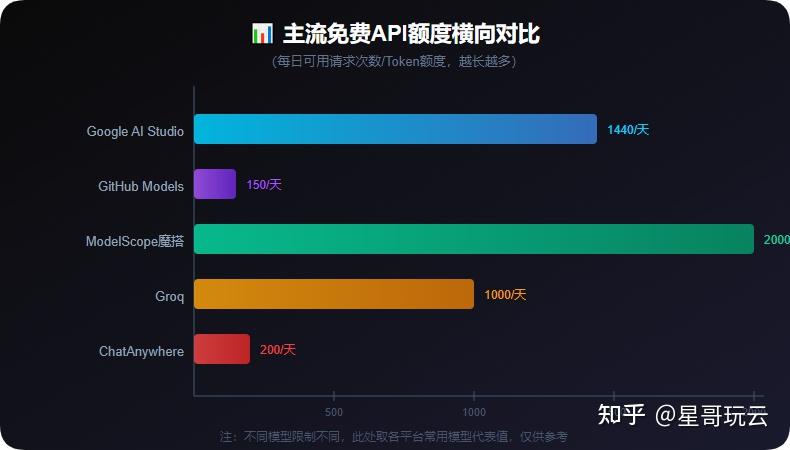

五、额度对比一览

数字更直观,看图说话:

简单来说:

- 每天次数最多:Google AI Studio Gemini 2.5 Flash(1440次)、ModelScope(2000次)

- Token 总量最多:智谱 AI 新用户(2000万 Token)

- 速率最快:Groq(推理硬件优势)

- 模型最丰富:HuggingFace、OpenRouter

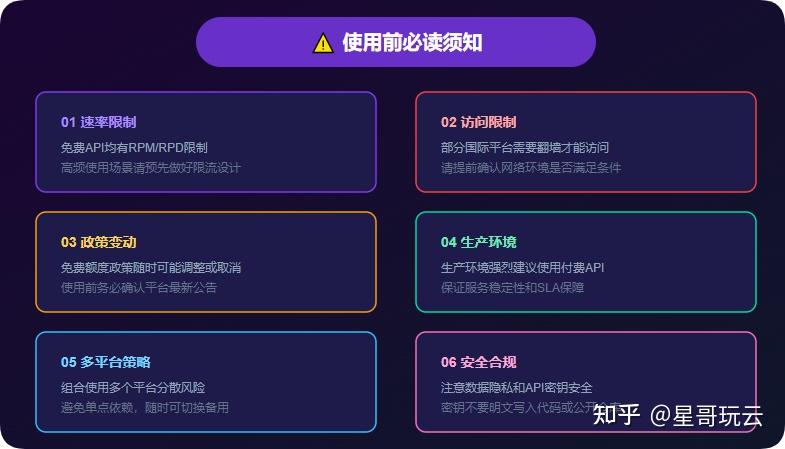

六、使用前的六个注意事项

在你拿着这份清单去薅羊毛之前,有几件事必须提前知晓:

- 速率限制要做好降级处理:几乎所有免费 API 都有 RPM(每分钟请求数)和 RPD(每日请求数)限制。建议在代码里加上指数退避重试逻辑,遇到 429 错误时自动等待后重试,而不是直接报错崩溃。

- 国际平台记得确认网络环境:Google AI Studio、HuggingFace、Cerebras 等平台需要翻墙才能访问。如果你的服务器在国内,需要提前配置代理,或者改用国内替代方案。

- 免费政策随时会变:这份名单里的额度数据截至 2026 年 3 月,各平台的免费政策可能随时调整。建议使用前去官网核实最新信息,别到生产环境才发现额度已经砍了。

- 生产环境请用付费 API:免费套餐适合开发、测试、学习。一旦上生产,SLA 保障、优先级排队、技术支持都需要付费版才有。用免费 API 跑生产流量是在赌运气。

- 多平台组合分散风险:单一依赖某一家平台,遇到宕机或政策调整时会很被动。建议做好多平台 fallback 策略,比如主用智谱 GLM,备用硅基流动或 OpenRouter。

- API 密钥安全务必重视:密钥一旦泄露,别人消耗的是你的额度(甚至你的钱)。不要把密钥明文写进代码、提交到 GitHub,使用环境变量或密钥管理服务统一管理。

全平台汇总表

国内平台

| 平台 | API地址 | 免费额度 | 特点 | 限制 |

|---|---|---|---|---|

| 智谱AI | http://open.bigmodel.cn | 新用户2000万Token | GLM-4-Flash永久免费 | 并发30 |

| 月之暗面Kimi | http://platform.moonshot.cn | 3次/分钟,不限Token总量 | 256K超长上下文 | 3 RPM |

| 硅基流动 | http://api.siliconflow.cn | 1000 RPM/模型 | DeepSeek/Qwen3支持 | 每模型独立计量 |

| OpenRouter | openrouter.ai | 50次/天免费 | 国内直连,模型全 | 免费版限制较多 |

| ModelScope魔搭 | http://modelscope.cn | 2000次/天 | 多模态 | 深度推理限200次/天 |

| 阿里通义千问 | http://bailian.console.aliyun.com | 新用户测试额度 | Qwen3系列 | 需申请 |

| 百度文心 | http://cloud.baidu.com | 需申请 | 数理逻辑强 | 需预约 |

| 腾讯混元 | http://cloud.tencent.com | 新用户测试额度 | 数学方向强 | 需申请 |

| 字节豆包 | http://volcengine.com | 新用户测试额度 | 多模态,价格低 | 需申请 |

| 讯飞星火 | http://xinghuo.xfyun.cn | 新用户测试额度 | 联网搜索,绘图 | 需申请 |

| intern-ai | http://chat.intern-ai.org.cn | 10 RPM | InternVL3-78B | 密钥6个月有效 |

国际平台

| 平台 | API地址 | 免费额度 | 特点 | 需要翻墙 |

|---|---|---|---|---|

| Google AI Studio | http://generativelanguage.googleapis.com | Gemini 2.5 Flash: 30RPM/1440RPD | 多模态,性能强 | ✅ |

| GitHub Models | models.github.ai | 15RPM/150RPD | GPT-4.1/4o,GitHub账户即用 | ❌ |

| HuggingFace | http://huggingface.co | 每月可变积分 | 开源模型宝库 | 部分需要 |

| Groq | http://groq.com | 1000次/天 | LPU超快推理 | ✅ |

| Cloudflare Workers AI | http://developers.cloudflare.com | 10000 Neurons/天 | 全球CDN加速 | ❌ |

| NVIDIA NIM | http://integrate.api.nvidia.com | 开发者计划免费 | DeepSeek-v3.2 | ✅ |

| Mistral | console.mistral.ai | 1req/s,500K tokens/min | 欧洲高性能模型 | ✅ |

| Cerebras | inference.cerebras.ai | 30RPM,60K tokens/min | 极速推理,需等待列表 | ✅ |

| Scaleway Generative | http://scaleway.com | 100RPM,200K tokens/min | 免费测试中 | ✅ |

| OVH AI Endpoints | http://endpoints.ai.cloud.ovh.net | 12 RPM | 开源模型 | ✅ |

| Together Free | together.ai | Meta-Llama系列 | 无具体限制说明 | ✅ |

| Fireworks AI | fireworks.ai | 免费1积分 | 高并发支持 | ✅ | | AI21 Labs | http://ai21.com | 10积分,无需信用卡 |

Jamba系列 | ✅ |

| Cohere | api.cohere.ai | 20 RPM | command-a系列 | ✅ |

七、总结

好了,以上就是 2026 年最全的免费大模型 API 攻略,从国内到国际,从官方到代理,该说的都给你扒清楚了。最后再啰嗦两句:免费额度虽香,但别拿来跑生产环境,速率限制记得做重试,密钥别瞎放,多备几个平台以防万一。毕竟羊毛随时可能变,但只要找对路子,日常开发、学习测试完全不用花一分钱!赶紧收藏起来,挨个去试试,有啥新发现也欢迎评论区聊聊~